分析用データの準備と統合を容易にする GCP の新サービス

Google Cloud Japan Team

分析用データの準備機能と統合サービスの新たなサポートにより、データから素早く価値を引き出せるようになります。

データの量や速度、種類に関係なく、そこから価値を引き出すことに、Googleは 従来型データ ウェアハウスの時代から長く取り組んできました。そして今、Google BigQuery への関心が高まり、導入が加速していることは、多くの組織にとって “citizen data science”(いわゆる「データ分析の民主化」の意)文化の構築が手の届くところまで来ていることを示唆しています。

とはいえ、まだやることはあります。お客様やパートナーに話を聞くと、データ分析を阻む課題が依然として存在することがはっきりします。インフラを構築し保守していく時間やコストの確保や、分析に適したデータセットをビジネス ユーザーに簡単かつ安全に提供できるかということです。なかでも分析に使用するデータの準備が大変で、一部のお客様は総作業処理時間の最大 80 % をデータ準備に費やしています。

私たちは今回、Google Cloud Next '17 にて、こうした課題に直接対応できる新しい製品やサービスを発表しました。これらにより、さまざまな規模の企業が、基盤となるインフラの構築や統合、管理に多くの時間とリソースを割くのではなく、データによってビジネスの課題を解決することに注力できるようになります。

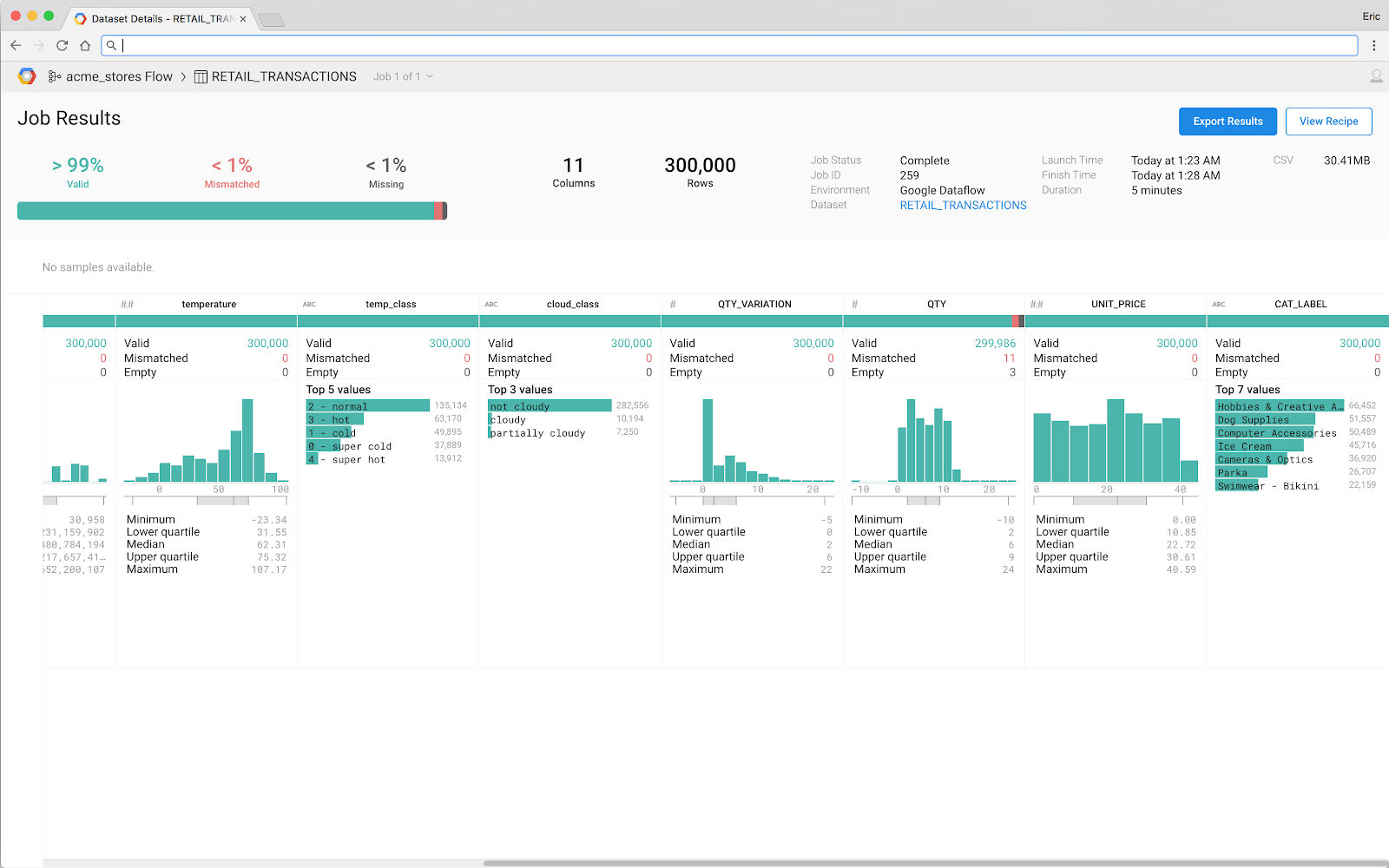

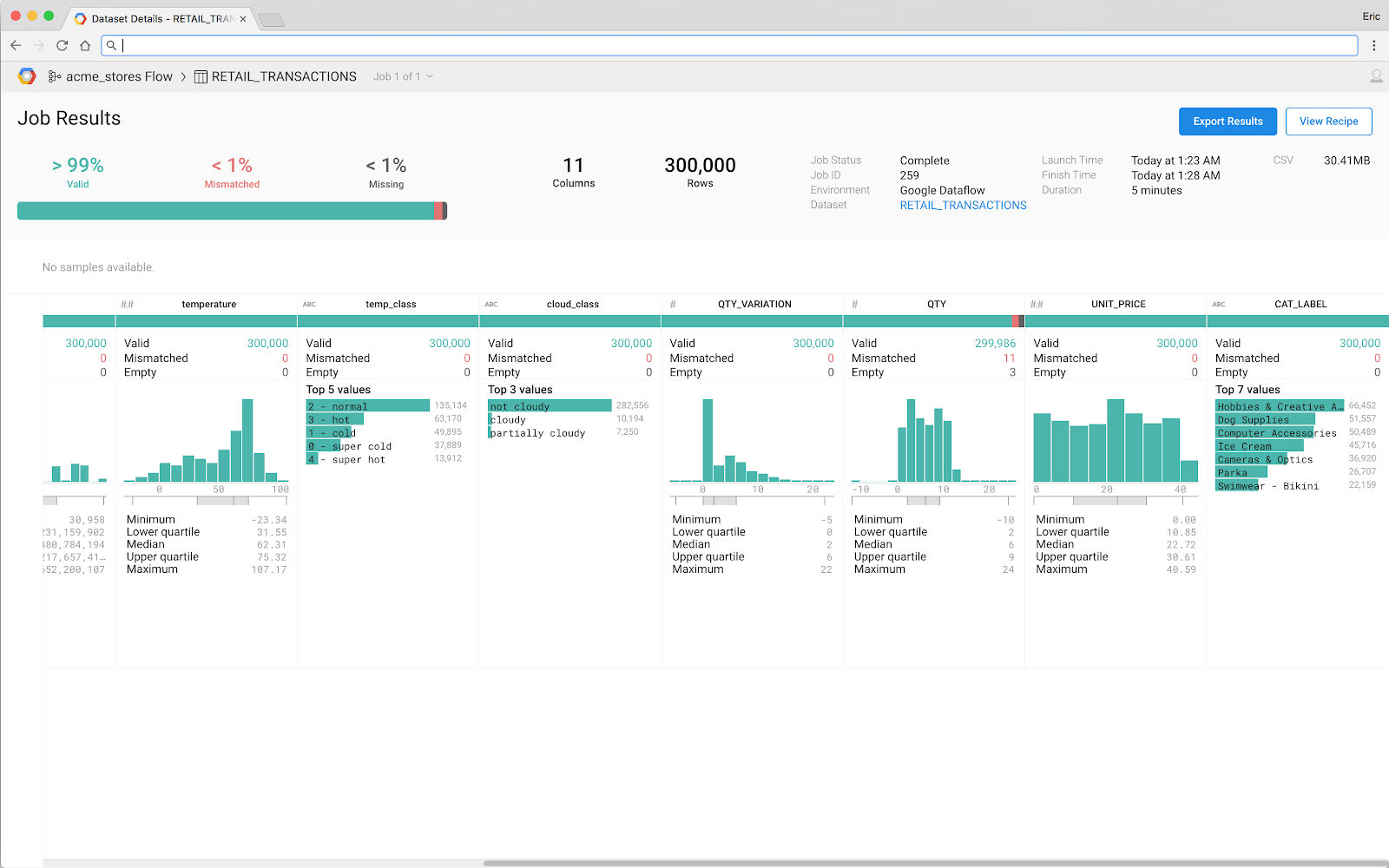

Cloud Dataprep で分析用データの準備が容易に

Google Cloud Dataprep(現時点ではプライベート ベータ)は、Trifacta とのコラボレーションによって生まれた新しいマネージド データ サービスです。このサービスは以下の機能をサポートしており、これらを使用すれば、アナリストやデータ サイエンティストは瞬時に分析用データを視覚的に探索し準備することができます。- 異常検知 : スキーマ、タイプ、ディストリビューション、値の欠如 / 不一致を自動的に検知します。機械学習を駆使することで、訂正データの変換を提案します。

- ドラッグ & ドロップによる開発 : コーディング不要の直感的なユーザー エクスペリエンスにより、分析に集中できます。

- Google Cloud Platform(GCP)との独創的な統合 : Google Cloud Storage や BigQuery から生データを安全に読み込んだり、ローカル マシンからデータをアップロードしたり、より詳細な分析のためにクリーン データを BigQuery に再度書き込んだりすることができます。

- フルマネージド インフラストラクチャ : Google が提供する他のマネージド サービスと同様に、ITリソースのプロビジョニングおよび管理が自動的かつ柔軟に処理されます。

BigQuery の機能強化 : Data Transfer Service とフェデレーテッド クエリ

BigQuery は、分析経験が浅いユーザーでも驚くべきインサイトを発見できる、新しいタイプのクラウド ネイティブなエンタープライズ データ ウェアハウスとして、Hearst や The New York Times といったお客様の間で評価を確立しています。このたび、そうした BigQuery に新しい機能が 2 つ加わり、クラウド全体からデータに簡単にアクセスできるようになったほか、より迅速にインサイトが得られるようになりました。- 新しい BigQuery Data Transfer Service により、Google 管理下の広告データセット全体から迅速に価値を引き出すことが容易になります。たとえば数クリックするだけで、マーケティング アナリストは、Google Adwords や DoubleClick Campaign Manager、DoubleClick for Publishers、さらには YouTube Content and Channel Owner Reports からのデータ インポートをスケジューリングできるのです。デジタル広告のデータを(POS データや在庫表、顧客サービスのリクエストなど)既存のレポート データと一元化することで、マーケティング内容をより詳しく全体的に見渡せるようになります。こうしたサービスを、Google Data Studio や可視化ソリューションを提供する Google のパートナー(Tableau、Looker、Zoomdata など)のソリューションと組み合わせれば、インサイトにたどり着くまでの時間をさらに短縮できます。

- BigQuery がサポートするクエリの対象範囲に Google Cloud Bigtable が加わりました。Cloud Bigtable は、低レイテンシや高スループットを要求する大規模な分析や操作のワークロード(特に一般的な金融サービスや IoT のユース ケース)向けに設計された NoSQL データベース サービスです。BigQuery ユーザーはすでに、Google Cloud Storage、Google Drive、Google Sheets 内のデータをクエリすることができます。これに Cloud Bigtable 内のデータが加わったことは、あらゆる種類のデータをシステム間でコピーすることなく BigQuery で便利に分析できることを意味し、シームレスなクラウド プラットフォームへのさらなる一歩となります。

BigQuery で商用データセットを利用

企業はしばしば、社外で提供されている(公用や商用の)データセットを必要とします。商用のデータセットには、Xignite が提供する金融市場データ、HouseCanary の(過去と推定の)住居用不動産評価データ、Remine が予測する家の売却時期データ、AccuWeather による過去の天候データ、Dow Jones のニュース アーカイブなどがあります。これらのデータはすべて BigQuery で利用可能です(今後新たなパートナーがプログラムに参加する予定で、利用可能なサービスがさらに追加されます)。

データ提供事業者からデータセットを購読すれば、こうしたデータを BigQuery ですぐにクエリできます。これでお客様は、データを収集して保存し、そのバージョンを管理する方法に頭を悩ます必要がなくなり、データから価値を引き出すことに注力することができます。

Google Cloud のおかげで、Dow Jones が有する世界レベルのコンテンツやデータに対して、これまで以上に簡単にアクセスできるようになりました。これにより、アナリストやデベロッパーは最新のデータ分析や機械学習のツールを駆使し、ビジネス クリティカルな情報とワークフローを統合できます。

Clancy Childs 氏、Chief Product & Technology Officer、Dow Jones

続いて、GCP データ アナリティクス スタックに関するその他の発表について紹介します。

Cloud Dataflow 向け Python SDK の正式リリース

Google Cloud Dataflow のサーバーレスなアプローチにより、バッチ処理やストリーミング処理におけるデータ処理の複雑さや運用負荷が大幅に軽減されます。最近までその恩恵を受けられるのは Java デベロッパーのみでしたが、このほど Cloud Dataflow 向けの Python SDK が正式リリースされました。SDK は Apache Beam から直接提供されます。Cloud Dataflow での SDK の実装は、ETL、大規模画像処理のオーケストレーション、機械学習のためのデータ準備など、Python の一般的なユース ケースで高い評価を受けています。

Cloud Dataflow ジョブを監視する Stackdriver Monitoring(ベータ)

Google Stackdriver は、GCP や AWS で稼働しているアプリケーションの監視および診断機能を提供します。この Stackdriver Monitoring を Cloud Dataflow と統合する機能は、お客様から最も多く寄せられた要望の 1 つであり、このほどパブリック ベータ版をリリースできたことをうれしく思います。今回のパブリック ベータでは、Cloud Dataflow の測定基準にアクセスして分析を行い、特定の Cloud Dataflow ジョブの条件に応じてアラートを作成できます。たとえば、ストリーミング システムの遅延を示すダッシュボードを作成し、事前に定義したしきい値を超えた場合のアラートを定義することで、アラートの発生時にメールや SMS で通知を受け取ることが可能です。

Cloud Datalab の正式リリース

インタラクティブなデータ サイエンス ワークフロー ツールである Google Cloud Datalab が正式リリースされました。このツールは、標準 SQL、Python、シェル コマンドを使っている Jupyter ノートブック ベースの環境において反復モデルやデータ分析を容易にします。BigQuery や Cloud Storage のデータ、さらにはローカルに保存したデータの調査や分析、可視化を行ううえで、デベロッパーやデータ サイエンティストの役に立ちます。Cloud Datalab を使用すれば、機械学習開発プロジェクトのライフサイクル全体を見据えたアプローチをとることができます。最初はローカルに格納されている小規模なデータセットでプロトタイプを作り、次に Cloud Storage のフルデータ セットを使ってクラウドで訓練するのです。

今回の正式リリース版では、新たに TensorFlow と Scikit-learn をサポートするとともに、Cloud Dataproc を介して Cloud Dataflow や Apache Spark を利用することで、バッチおよびストリーミング処理にも対応できます。

Cloud Dataproc のアップデート

Google Cloud Dataproc は、Apache Spark や Flink、Hadoop のパイプラインを稼働させるためのフルマネージド サービスです。ストリーミング処理を容易にし、パイプラインの開発を加速させ、お客様がクラスタの管理をより柔軟に行えるようにすることを目指して設計されています。こうした目標の実現に向け、このほど以下のような改良が加えられました。

- 失敗したジョブを自動で再始動する新機能により、長期稼働型のジョブやストリーミング関連のジョブの耐久性が向上しました(ベータ)。

- ライトウェイトなデータ サイエンス、教育、サンドボックス開発のために、単一ノードのクラスタを作成できるようになりました(ベータ)。

- ゲノム解析のような計算集約型ジョブを伴うワークロード向けに、Cloud Dataproc のクラスタに GPU を追加できるようになりました(ベータ)。

- Cloud Dataproc User Labels が正式リリースされ、Cloud Dataproc のリソース管理がより柔軟になりました。

- Regional endpoints が利用可能になり、必要に応じて Cloud Dataproc のリソースをうまく分離でき、パフォーマンスも向上しました。

- Java SSL プロバイダーを BoringSSL ベースのプロバイダーに変更したことで SSL が最適化され、Cloud Storage のオペレーションが高速になりました。

次のステップ

今回の発表により、お客様は以下のサービスをうまく組み合わせることで、どのようなシナリオに対してもデータ分析を迅速に行い、価値を引き出せるようになります。- 分析用データの準備作業を簡素化する Cloud Dataprep(新)

- データ統合を実現する BigQuery Data Transfer Service と商用データセット(新)

- 迅速かつ簡単なデータ取り込みとデータ処理が可能な Cloud Dataflow および Cloud Pub/Sub

- 迅速なインタラクティブ SQL アナリティクスが可能な BigQuery

- Spark パイプラインを実行できる Cloud Dataproc

- データ サイエンスのワークフローを支援する Cloud Datalab

- 大規模な機械学習に対応した Cloud Machine Learning

- エコシステムが充実し、成長中のパートナー ソリューション

* この投稿は米国時間 3 月 9 日、Google Cloud Platform の Director of Product Management である Fausto Ibarra によって投稿されたもの(投稿はこちら)の抄訳です。

- By Fausto Ibarra, Director of Product Management, Google Cloud Platform